据Gartner称,到 2030 年,在一个拥有万亿参数的大型语言模型(LLM)上进行推理的费用将比 2025 年降低 90%以上,这将使生成式人工智能(GenAI)提供商节省大量成本。

AI 令牌是生成式人工智能模型处理的数据单位。在本次分析中,一个令牌相当于 3.5 个字节的数据,即约 4 个字符。

Gartner高级分析师Will Sommer说道 :“这些成本的降低将得益于半导体和基础设施效率的提升、模型设计的创新、芯片利用率的提高、对特定用途的专用推理芯片的更多使用,以及边缘设备在特定场景中的应用等多方面的因素。”

由于这些趋势的影响,Gartner预测,到 2030 年,大型语言模型的成本效益将比 2022 年开发的同类规模的早期模型高出多达 100 倍。

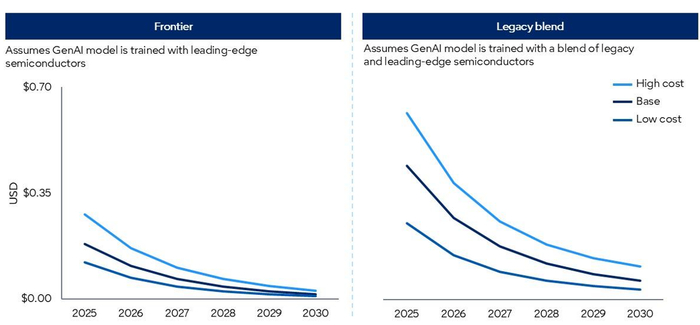

预测模型的结果被分为两组半导体情景:

前沿情景:模型处理基于尖端芯片的模拟数据。

传统混合情景:模型处理基于现有半导体的典型组合,该组合参照了高德纳咨询公司的预测数据进行评估。

在“混合”预测情景中,所计算出的成本明显高于“前沿”情景。

通用人工智能推理成本的预测情景

费用的降低并不会使前沿智能技术普及化

然而,生成式人工智能服务提供商的代币价格下降并不会完全转嫁给企业客户。此外,前沿智能应用所需的代币数量将远远超过当前主流应用。例如,代理模型完成每项任务所需的代币数量是标准生成式人工智能聊天机器人的 5 到 30 倍,并且能够执行比人类使用生成式人工智能完成的任务更多的任务。

虽然较低的令牌单位成本将使更先进的生成式人工智能具备更强的能力,但这些进步将导致令牌需求大幅增加。由于令牌的消耗速度快于令牌成本的下降速度,总体推理成本预计将会上升。

Sommer表示:“首席产品官们不应将商品化代币的贬值与前沿推理的民主化相混淆。随着商品化的智能技术的成本趋近于零,支持高级推理所需的计算资源和系统仍然十分稀缺。那些如今用廉价代币掩盖架构效率低下问题的首席产品官们,明天将难以实现自主性的规模扩张。”

能够协调处理各种模型下的工作负载的平台将会获得价值。常规的、高频的任务必须被分配给更高效的小型且针对特定领域的语言模型,因为这些模型在成本仅为通用解决方案的一小部分的情况下,能以更好的表现完成特定工作流程的任务。前沿级别的模型的高成本推理必须受到严格限制,并且专门用于高利润、复杂推理的任务。